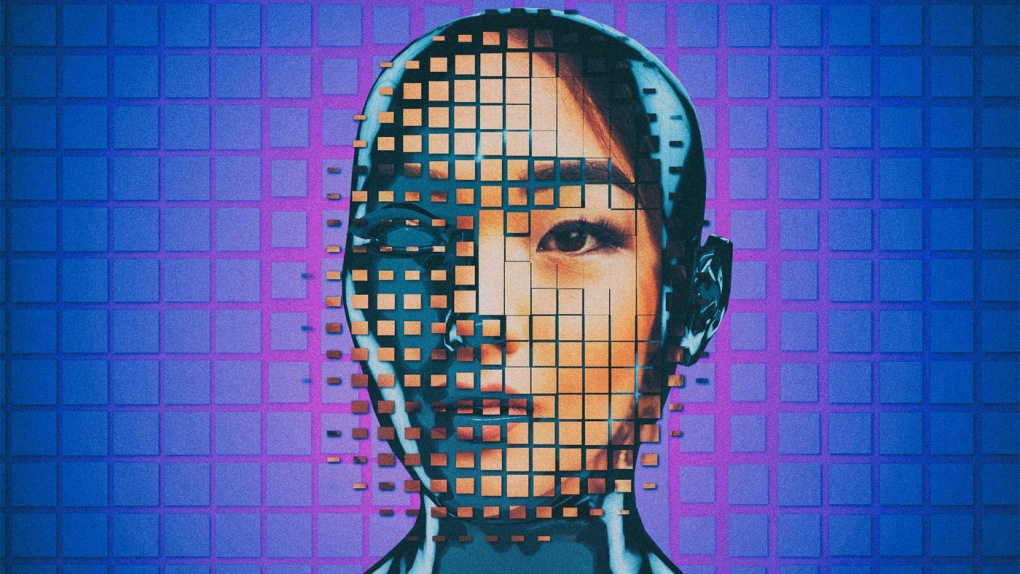

Nhân viên chuyển 25 triệu USD sau cuộc gọi deepfake giả danh sếp

Nhân viên một công ty đa quốc gia ở Hong Kong đã chuyển 200 triệu HKD sau khi nhận cuộc gọi video từ "giám đốc tài chính".

Theo SCMP, cảnh sát Hong Kong tuần này cho biết chi nhánh của một công ty đa quốc gia giấu tên đã bị lừa đảo bởi deepfake. Trừ nạn nhân, những người có mặt trong cuộc gọi video đó đều được tạo bằng AI, "trông giống và nói giống người thật".

"Những kẻ lừa đảo áp dụng deepfake để biến video có sẵn kết hợp các cảnh quay thành một cuộc họp đầy thuyết phục", Baron Chan Shun-ching, đại diện cảnh sát Hong Kong nói, cho biết họ đang tập trung điều tra bởi đây là vụ án lớn liên quan đến deepfake.

Sự việc xảy ra vào tháng 1, khi một nhân viên phụ trách tài chính chi nhánh công ty ở Hong Kong nhận được cuộc gọi video từ giám đốc tài chính (CFO) và các thành viên tại Anh, đề cập đến một "giao dịch bí mật cần phải thực hiện".

Theo ông Chan Shun-ching, ban đầu người nhân viên có "vài giây nghi ngờ". Tuy nhiên, sự có mặt của CFO cùng các đồng nghiệp quen mặt trong cuộc họp khiến người này tin tưởng.

Sau đó, nhân viên được hướng dẫn chuyển tiền. Tổng cộng đã có 15 lần chuyển khoản được thực hiện với trị giá 200 triệu HKD (25 triệu USD) tới 5 tài khoản ngân hàng khác nhau ở Hong Kong trước khi tiếp tục bị chuyển ra nước ngoài. Toàn bộ sự việc kéo dài một tuần kể từ khi nhân viên được liên lạc đến khi người này nhận ra trò mạo danh và báo cho công ty.

"Kẻ lừa đảo đã sử dụng công nghệ deepfake để ghép khuôn mặt và bắt chước giọng nói từ tệp âm thanh có sẵn, giúp đánh lừa nhân viên", Shun-ching cho biết. "Trong cuộc gọi, chúng dường như không tương tác mà chủ yếu ra lệnh trước khi kết thúc đột ngột, nhưng nạn nhân không nhận ra".

Cũng theo cảnh sát, kẻ lừa đảo cũng tiếp cận một số nhân viên khác tại chi nhánh bằng chiến thuật tương tự, nhưng chi tiết cụ thể không được đề cập.

Deepfake là sự kết hợp giữa "deep learning" (học sâu) và "fake" (giả). Công nghệ này sử dụng AI phân tích cử chỉ, nét mặt và giọng nói của một người, từ đó tái tạo và chỉnh sửa để cho ra đời ảnh hoặc video trông như thật về người đó, thậm chí bao gồm cả hình ảnh và tiếng nói. Theo NBCNews, các nhà nghiên cứu hiện lo ngại deepfake dần trở thành nguồn tin sai lệch bị lan truyền mạnh mẽ khi cho phép bất cứ ai cũng tạo được ảnh giả mạo hay ảnh khỏa thân về các ứng cử viên chính trị, người nổi tiếng.

Gần nhất, hình ảnh deepfake của Taylor Swift xuất hiện trên X đã có tới 47 triệu lượt xem trước khi bị khóa hôm 25/1. Theo công ty an ninh mạng Reality Defender, 90% ảnh giả mạo của nữ ca sĩ được tạo ra bằng mô hình Stable Diffusion - nền tảng AI có thể được truy cập thông qua hơn 100.000 ứng dụng và các công cụ online.

Kết nối truyền thông

cùng 24HMONEY ?

Liên hệ tư vấn ngay

Bạn muốn trở thành

VIP/Pro ?

Đăng ký ngay

Bàn tán về thị trường